原文始发于微信公众号(AIGC自习室):Sora横空出世,对AIGC意味着什么?

OpenAI2月16日凌晨发布“王炸”文生视频大模型Sora,再次引爆科技圈。在OpenAI官网分享的演示视频中,Sora可以直接输出有多个角色、多种场景和运镜的画面。这对比一年前 AI 生成的视频,简直是天差地别,其视频长度方面就“碾压”同行。

方正证券分析师郑震湘领导的团队在题为《AI巨轮滚滚向前》报告中直言,文生视频大模型Sora震撼登场,AIGC新时代已至。

Sora完美继承DALL·E 3的画质和遵循指令能力,并利用了GPT扩写,具备超长生成时间(60s)、单视频多角度镜头、理解物理世界三大突出优势:

模型对物理世界的理解愈加接近现实,已具备商业化落地价值,创作内容产业革命来临,AIGC新时代到来了。

方正证券在报告中指出,英伟达正式发布Chat With RTX,AI加速普及,通用人工智能时代也正加速来临。在高性能AI处理器的加持下,AI+N类终端的时代浪潮已至,AI改变的不只是 PC 与手机,科技赋能将全方位渗透,消费电子也将迎来全新的增长机遇:

我们认为MR是AI最佳落地终端,泛社交、B端应用拓展也拥有想象空间。

报告称,核心公司业务进展近况进一步印证了现阶段块发展两个核心要素:AI方向的持续产品迭代、庞大的国产化算力需求。预计在AI 算力需求高景气的背景下,国内AI算力产业链将在2024年迎来更加快速的发展。

AIGC时代已至

方正证券在报告中指出,从Runway、Pika 到 Sora,文生视频大模型频出,视频长度从表情包长度的3s、4s 到主流短视频长度的60s,模型对物理世界的理解愈加接近现实,已具备强大的商业化落地价值,创作内容产业革命来临,AIGC 新时代已至:

在算力需求大、高质量数据集短缺、可控性较差等挑战下,文生视频是AIGC的高地,除Runway、Pika之外,Stability AI 也发布了 Stable Video Diffusion 视频模型,用户可根据需要调整各种参数,如迭代步数、重绘幅度等,以协助创作者精确掌控画面生成过程,Meta推出了两项基于AI的视频编辑新功能;在开源上,AnimateDiff、MAKEAVIDEO、MagicAnimate 等也在布局 AI 视频生成赛道。

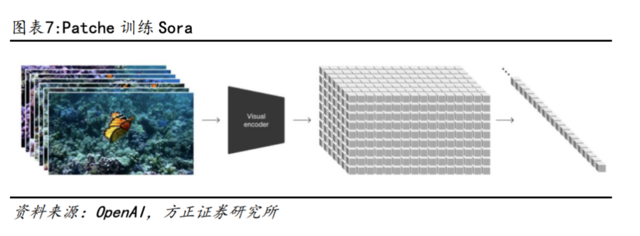

报告称,Sora震撼效果的原因主要有:1)训练端:基于 Transformer 架构的扩散模型,降维并通过Patche 进行训练;采样的灵活性与独特的训练路径(原始 尺寸、时长训练);利用DALL·E 3 re-captioning 功能,给训练用的视频素材都加上高质量文本描述;2)输入端:利用 GPT 先将用户输入的提示词精准详尽扩写,再将扩写后的提示词交给 Sora:

Sora 是一种扩散模型,可在学习大量先作的时候,学会图像内涵与图像之间的关系,采用 Transformer 架构(主流视频生成扩散模型较多采用 U-Net 架构),OpenAI 认为 之前在大语言模型上的成功得益于 Token,Token 可以把代码、数学以及各种不 同的自然语言进行统一,进而方便规模巨大的训练,因此 OpenAI 创造了对应 Token 的 Patche,用于训练 Sora。

为减少 Transformer 带来的计算量压力,OpenAI 开发了一个视频压缩网络,把视频先降维到潜空间(latent,用更少的信息去表 达信息的本质),然后再去拿这些压缩过的视频数据去生成 Patche,这样就能使输入的信息变少。

方正证券认为,AI大模型的发展正不断加速AGI通用人工智能的到来,纵观整个AI产业链,硬件和软件的配合才能更好地实现多种终端应用的价值化落地,可以预见的是,未来的 AI 时代又是生产力的爆发式革命:

其中上游的基础层包括AI模型生产工具(AI 算法框架+AI 开发平台+AI 开放平台+预训练大模型)、AI 算力基础 (AI 芯片+服务器+智算中心+云服务)、AI 数据资源(AI 基础数据服务+数据治 理);

中游的技术层包括计算机视觉、智能语音、自然语言处理、知识图谱和机器学习;

下游的应用层则是百花齐放,以 AI+泛安防/泛互联网/媒体/金融/医疗/工 业/零售/政务为代表,还包括对话式 AI、机器人、自动驾驶、无人机等。

“AI+终端”智能化加速

方正证券认为,手机、MR、机器人等新品迭出,诸多新品亮相,AI终端时代来临。英伟达、AMD、高通分别推出GeForceRTX 40 SUPER 系列、锐龙8000G 系列、骁龙XR2+ Gen 2 等高性能处理器,性能水平实现跃升,助力AI加速渗透PC、汽车、智能家居等终端场景:

我们看到,三星大力布局人车互联生态;英特尔在发布AI PC 平台的同时,推出SDV SoC 赋能AI+汽车;戴尔灵越系列搭载英特尔酷睿Ultra 7,AI 能效再度提升;联想十余款AI PC 产品发布,规模化落地逐步推进。华硕搭载酷睿Ultra 9,各系列产品针对不同的目标客户进行性能或配置上的优化,满足差异化需求。

我们认为,在高性能AI 处理器的加持下,AI+N 类终端的时代浪潮已至,AI 改变的不只是PC 与手机,科技赋能将全方位渗透,消费电子也将迎来全新的增长机遇。

报告指出,MR为AI最佳落地终端,高度赋能MR 内容与硬件,泛社交、B 端应用拓展也拥有想象空间:

1)办公场景:Workrooms 是一个身临其境的虚拟办公室,无论是戴着 Meta Quest 头戴式耳 机,还是从 2D 屏幕上加入,都可以在这里与队友会面、集思广益、分享演示文 稿并完成工作。同时,Workrooms 还支持 Zoom,让连接更方便。

2)政府服务:首尔市政府正式开展元宇宙服务,建立涵盖经济、教育、税务和行政等领域的行 政服务平台。该市还打算在接下来的五年里陆续推出更多涉及政府、商业、旅游和文化的服务。

3)金融服务:中国工商银行虚拟营业厅率先构建 “VR 智能眼镜+元宇宙+智慧金融”场景。在 虚拟营业厅中,用户仿佛置身于真实的全景环境,不仅能体验行走的空间感、纵 深感,对网点的格局、设施、产品展示、展品细节、空间的大小也都能一目了然。

4)医疗场景:内置 AI 医疗系统的 AR 眼镜可以用于病情诊断、远程会诊和医疗教学。

AI驱动全球算力硬件环节创新与需求共振

方正证券认为,英伟达以及AMD等核心公司的业务进展近况进一步印证了现阶段板块发展两个核心要素:AI方向的持续产品迭代、庞大的算力需求:

首先从英伟达来看:H200 出货在即,B100 在路上。2023年11月13日,英伟达发布首款搭载HBM3e 的GPU H200,借助HBM3e,H200 能以每秒4.8 TB 的速度提供141GB 内存,与NVIDIA A100 相比,容量几乎翻倍,带宽增加2.4倍。搭载HBM3e 的H200 在处理700 亿参数的大模型时,推理速度较H100 快了整整一倍,能耗降低了一半。受HBM3E 供应限制,预计H200 将于24Q2 实现出货。

英伟达B100原计划发布时间为2024Q4,但由于AI 需求的火爆,已经提前至2024Q2,目前已经进入供应链认证阶段,B100 将能够轻松应对1730 亿参数的大语言模型,比当前型号H200 的两倍还要强大。

此外,B100 将采用更高级的HBM 高带宽内存规格,有望在堆叠容量和带宽上继续突破,超越现有的4.8TB/s。根据英伟达产品路线图,预计2025 年将推出X100,进一步丰富GPU 产品矩阵,巩固英伟达AI 芯片龙头地位。

与此同时,英伟达进军定制AI芯片领域。根据 CNBC,英伟达目前正在策划建立全新部门旨 在为云计算企业和其企业提供定制化芯片业务。根据 CNBC,定制化芯片或将专注 于满足特定设备或者系统的性能和功耗要求,其中或将包含特定的处理单元,传 感器集成、专用硬件加速器,以满足特定领域的需求。

从AMD来看:MI300 正式发布,2024 年销售收入上调。CoWoS+SoIC 赋能3.5D 封装。2023 年12 月6 日,AMD 在Advancing AI 活动上宣布推出Instinct MI300X,采用了AMD CDNA3架构,搭载了8 块HBM3,容量达192GB。与MI250X 相比,计算单元增加了约40%、内存容量增加1.5 倍、峰值理论内存带宽3 增加1.7 倍。在某些工作环境中,性能可达H100的1.3 倍。

MI300X 采用3.5D 封装,即通过混合键合技术实现XCD、I/Odie 的3D 堆叠,其次在硅中介层上实现与HBM 的集成,从而实现了超过1500 亿个晶体管的高密度封装。该封装方案由台积电提供,搭配SoIC 技术与CoWoS 技术共同实现。

报告称,AI浪潮也在推动光模块、交换机配套升级 :

Coherent:800G产品环比持续高增,2025 年顺应AI 发展推进1.6T 商业化。2023Q4Coherent 实现收入11.31 亿美元,高于指引中值,yoy-17.45%,qoq+7.41%。受益于人工智能的蓬勃发展, AI/ML 相关数据收发器连续第三季获得强劲订单,800G 产品季度收入突破1 亿美元,环比增长超100%,800G出货量持续强劲增长,FY2024 公司预计超50%的数据通信收发器收入将来自人工智能相关应用,2025 年向1.6T 产品商业化发展前进以顺应AI 发展。

Arista:云、AI 和数据中心核心业务发展势头迅猛。Arista 在2023 年的核心业务由云、Al 和数据中心产品组成,建立在高度差异化的Arista 可扩展操作软件系统堆栈上,部署了10G、25G、100G、200G 和400G 的速度。

Arista 云网络产品提供了节能、高可用的区域,而不会增加冗余成本,因为数据中心对前端、后端存储和计算集群的带宽容量和网络速度都有很高需求。Arista 预计400 和800 千兆以太网将成为Al 后端GPU 集群的重要试点,预计2025 年实现Al 网络收入至少7.5 亿美元。