阶跃星辰 Step-Video-TI2V 图生视频模型开源,运动可控

发布时间:2025-03-21 16:06:36 | 责任编辑:字母汇 | 浏览量:545 次

在今年 2 月,阶跃星辰开源了两款 Step 系列多模态大模型——Step-Video-T2V 视频生成模型和 Step-Audio 语音模型,为开源社区贡献了自己的多模态力量。

今天,我们再接再厉,继续开源图生视频模型——Step-Video-TI2V,一款基于 30B 参数 Step-Video-T2V 训练的图生视频模型,支持生成 102 帧、5 秒、540P 分辨率的视频,具备运动幅度可控和镜头运动可控两大核心特点,同时天生具备一定的特效生成能力。

和目前已有开源图生视频模型相比,Step-Video-TI2V 不仅在参数规模上对该领域的研究提供了更高的上限,其运动幅度可控能力,更是能够平衡图生视频生成结果的动态性和稳定性,为创作者提供更为灵活的选择。

与此同时,Step-Video-TI2V 已完成与华为昇腾计算平台的适配,并在魔乐社区(Modelers)上线,欢迎前往体验。

Torch 昇腾适配链接:https://modelers.cn/models/StepFun/Step-Video-TI2V-NPU

MindIE 适配链接:https://modelers.cn/models/MindIE/StepVideo-TI2V

两大技术亮点解析:Step-Video-TI2V 是如何炼成的

相比文生视频模型 Step-Video-T2V,此次开源的 Step-Video-TI2V 主要针对图生视频任务做了两大关键优化:

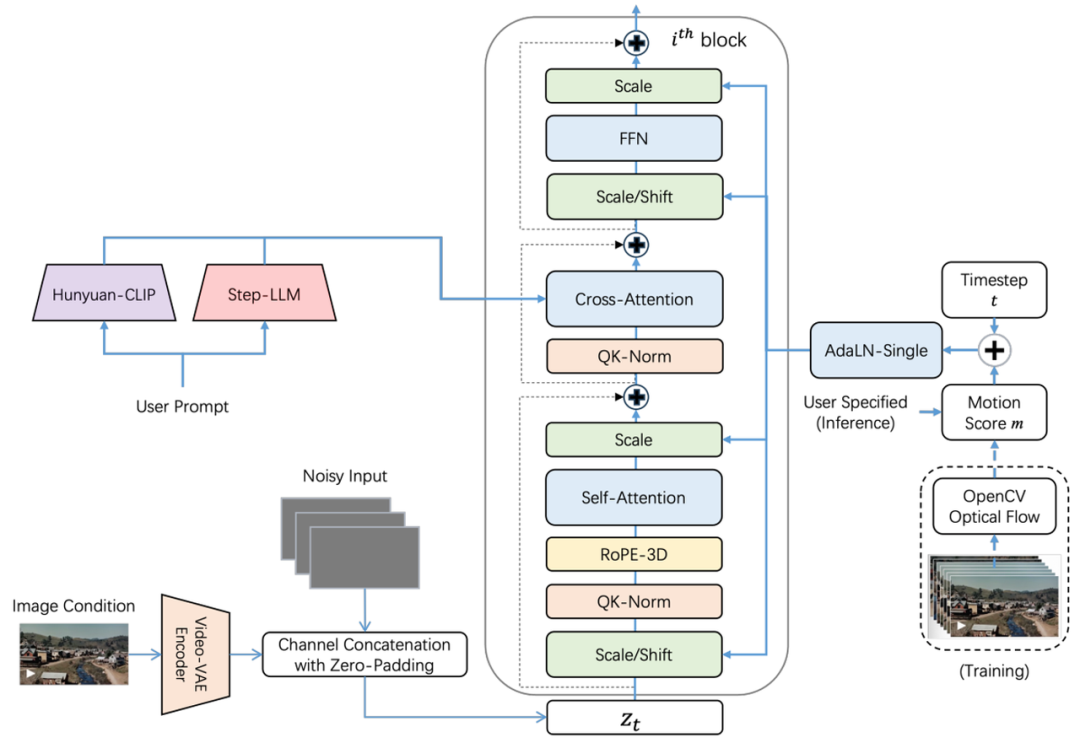

第一,引入图像条件,提高一致性

为了让模型更好地理解输入的图片,我们没有采用传统的 cross-attention 方法,而是使用了更直接、更高效的方式,将该图像对应的向量表示和 DiT 第一帧对应的向量表示直接进行 channel 维度的拼接,这样生成的视频和原图才能更一致。

第二,引入运动幅度控制,赋予用户更高自由度

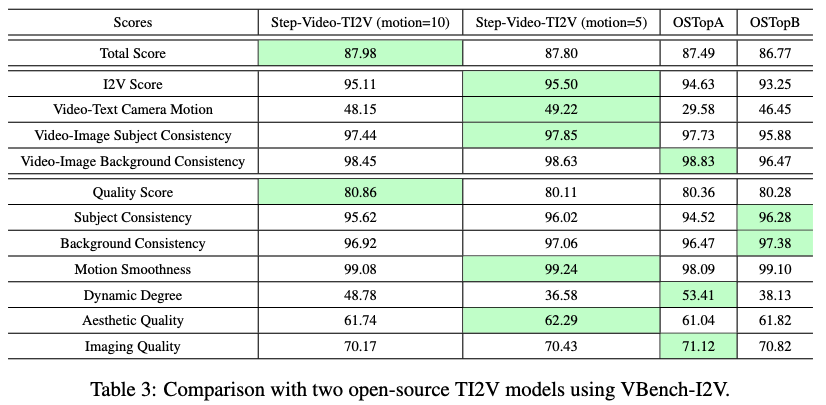

在训练过程中,Step-Video-TI2V 通过 AdaLN 模块引入视频动态性打分信息,特别训练模型学习了视频的动感程度。用户在生成时可以简单地指定不同的运动级别(motion = 2, 5, 10),精准控制视频的动态幅度,平衡视频的动态性、稳定性和一致性。

此外,在数据优化方面,对于主体动作和镜头运动,我们进行了专项精准标注,使得 Step-Video-TI2V 在主体动态性和运镜效果上更具优势。

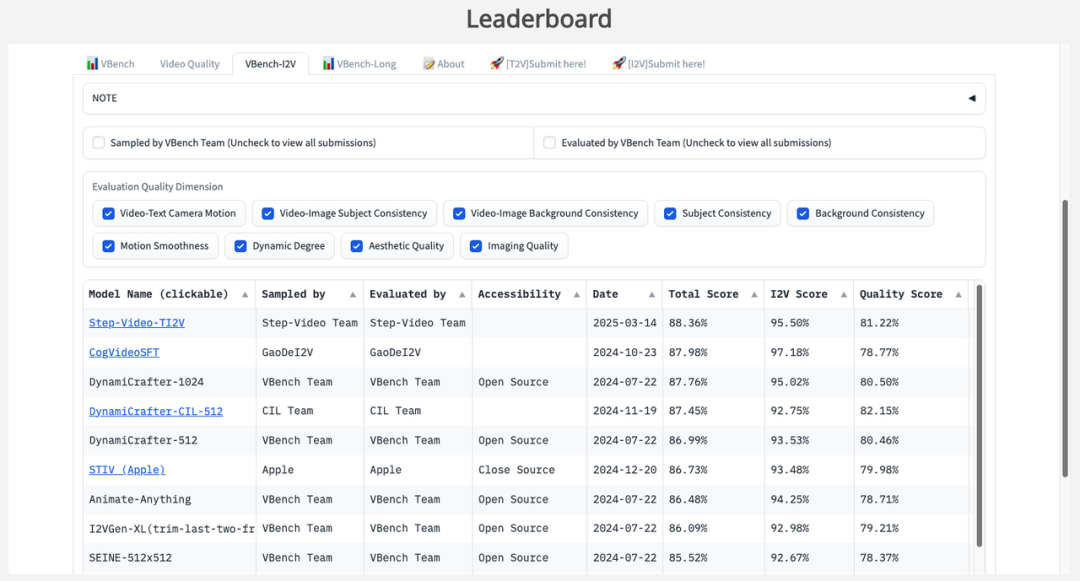

在 VBench-I2V 基准测试中,Step-Video-TI2V 取得了 state-of-the-art 级别的表现,并验证了动态性打分对生成视频稳定性和一致性的控制能力。

核心特点

1、运动幅度可控:动态 & 稳定自由切换

Step-Video-TI2V 支持控制视频的“运动幅度(motion)”,平衡图生视频内容的运动性和稳定性。无论是静态稳定画面,还是高动态动作场景,都能满足创作者需求。

2、多种运镜控制

除了对镜头内主体运动的控制, Step-Video-TI2V 支持对多种运镜的理解,可以对生成视频中的镜头运动进行精准控制,生成大片级运镜效果。从基本的推拉摇移、升降,到各种复杂的电影级运镜效果都能驾驭。

4、支持多尺寸生成

Step-Video-TI2V 支持多种尺寸图生视频,无论是横屏的宽阔视野,竖屏的沉浸体验,还是方屏的经典复古,都能轻松驾驭。

用户可以根据不同的创作需求和平台特性,自由选择图片尺寸,无需担心画面变形或比例失调的问题。

👉 网页版直达:

访问网址 跃问官网

👉 App 体验:

下载阶跃AI App,点击【视频创作】即可。

此外,Step-Video-TI2V 现在已初步具备一些特效生成能力,未来,我们还将通过 LoRA 等技术, 持续解锁模型的特效潜力,敬请期待更多惊喜!

本网站(https://aigc.izzi.cn)刊载的所有内容,包括文字、图片、音频、视频等均在网上搜集。

访问者可将本网站提供的内容或服务用于个人学习、研究或欣赏,以及其他非商业性或非盈利性用途,但同时应遵守著作权法及其他相关法律的规定,不得侵犯本网站及相关权利人的合法权利。除此以外,将本网站任何内容或服务用于其他用途时,须征得本网站及相关权利人的书面许可,并支付报酬。

本网站内容原作者如不愿意在本网站刊登内容,请及时通知本站,予以删除。